费雪信息

在数理统计学,费雪信息 (有时简称为 信息)是一种度量随机变量 X 所含有的关于其自身随机分布函数的未知参数 θ 的信息量。严格地说,它是分数对方差或观测信息的期望值。Fisher信息在最大似然估计量的大样本分布中地位是由统计学家罗纳德*费雪推广的(通过发展弗朗西斯*伊西德罗*埃奇沃思(Francis Ysidro Edgeworth)的初步结果)。费雪信息矩阵是可以用来计算最大似然估计量的协方差矩阵。 此外,它还用在一些统计检验量(比如瓦尔德检验)的公式中。

照例,上述来自Wikipedia的对Fisher information的描述

下面的描述来自知乎用户Data Scientist at Google /question/26561604

Fisher Information 的定义:

假设你观察到 i.i.d 的数据 服从一个概率分布,是你的目标参数(for simplicity, 这里是个标量,且不考虑 nuissance parameter),那么你的似然函数(likelihood)就是:

为了解得Maximum Likelihood Estimate(MLE),我们要让log likelihood的一阶导数得0,然后解这个方程,得到

这个log likelihood的一阶导数也叫,Score function :

那么Fisher Information,用表示,的定义就是这个Score function的二阶矩(second moment)

一般情况下(under specific regularity conditions)可以很容易地证明,, 从而得到:

于是得到了Fisher Information的第一条数学意义:就是用来估计MLE的方程的方差。它的直观表述就是,随着收集的数据越来越多,这个方差由于是一个Independent sum的形式,也就变的越来越大,也就象征着得到的信息越来越多。

而且,如果log likelihood二阶可导,在一般情况下(under specific regularity conditions)可以很容易地证明:

于是得到了Fisher Information的第二条数学意义:log likelihood在参数真实值处的负二阶导数的期望。这个意义好像很抽象,但其实超级好懂。

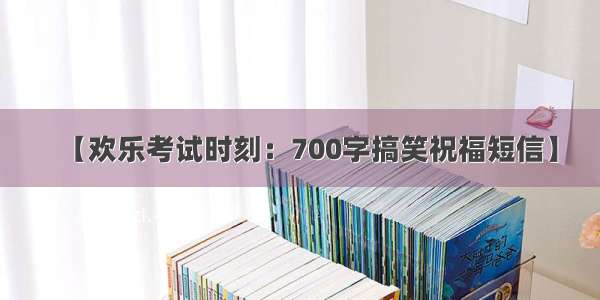

首先看一下一个normalized Bernoulli log likelihood长啥样:

<img src="/50/28c4c679b6758707ed779c066d0e8e3a_hd.jpg" data-rawwidth="900" data-rawheight="806" class="origin_image zh-lightbox-thumb" width="900" data-original="/28c4c679b6758707ed779c066d0e8e3a_r.jpg">对于这样的一个log likelihood function,它越平而宽,就代表我们对于参数估计的能力越差,它高而窄,就代表我们对于参数估计的能力越好,也就是信息量越大。而这个log likelihood在参数真实值处的负二阶导数,就反应了这个log likelihood在顶点处的弯曲程度,弯曲程度越大,整个log likelihood的形状就越偏向于高而窄,也就代表掌握的信息越多。然后,在一般情况下(under specific regularity conditions),通过对score function在真实值处泰勒展开,然后应用中心极限定理,弱大数定律,依概率一致收敛,以及Slutsky定理,可以证明MLE的渐进分布的方差是,即, 这也就是Fisher Information的第三条数学意义。不过这样说不严谨,严格的说,应该是 , 这里是当只观察到一个X值时的Fisher Information,当有n个 i.i.d 观测值时,。所以这时的直观解释就是,Fisher Information反映了我们对参数估计的准确度,它越大,对参数估计的准确度越高,即代表了越多的信息。